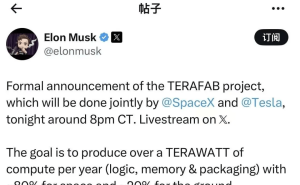

近期,生成式视频模型领域迎来重大进展,字节跳动推出的视频创作模型Seedance 2.0成为行业焦点。该模型发布后迅速在海外引发广泛关注,科技界名人马斯克在社交平台X上转发相关内容并评论“It's happening fast”,这一举动进一步放大了市场对视频生成技术快速发展的关注度,让Seedance 2.0的讨论热度持续攀升。

Seedance 2.0凭借独特的多模态创作方式和“自带运镜”的呈现效果,在内测阶段就吸引了全球众多目光。马斯克的公开评价虽未涉及具体技术细节,但强化了“发展速度”这一市场叙事。这不仅提升了外界对字节跳动多模态能力的关注,还可能对相关产业链的估值预期产生一定影响,使该模型的传播从技术圈层扩展到更广泛的科技投资与产品关注人群。

字节跳动在产品化方面动作迅速。目前,Seedance 2.0已正式接入豆包App、电脑端和网页版,全面融入豆包和即梦产品体系,同时上线火山方舟体验中心,面向广大用户开放试用。对于企业端,字节跳动计划在2月中下旬于火山方舟上线Seedance 2.0的API服务,助力企业客户更好地实现创意落地,这表明该模型不仅定位为创作工具,还在为更标准化的B端调用做准备。

字节跳动对Seedance 2.0的定位颇具野心,强调其“质量与可控性达到专业生产场景要求”。在功能方面,该模型亮点众多。它支持多模态输入,可混合文字、图片、音频、视频四种模态,参考构图、动作、运镜、特效、声音等元素进行创作。原声音画同步与多轨并行输出功能,能实现背景音乐、环境音效或人物解说等音频多轨输出,并与画面节奏精准对齐。多镜头长叙事与“编导思维”让模型可自动解析叙事逻辑,生成镜头序列,保持角色、光影、风格与氛围的统一。新增的视频编辑与视频延长能力,强化了“导演级操控”的工作流属性。字节跳动还表示,Seedance 2.0较好解决了物理规律遵循及长效一致性等难题,运动场景下的生成可用率达到业界领先水平。

尽管Seedance 2.0综合表现处于行业领先地位,但字节跳动也坦诚指出其存在优化空间。在产品介绍中明确提到,细节稳定性、多人口型匹配、多主体一致性、文字还原精度和复杂编辑效果等方面仍有待提升,未来将持续探索大模型与人类反馈的深度对齐。

在合规与使用边界方面,字节跳动也做出了明确规定。目前,Seedance 2.0限制使用真人图像或视频作为主体参考,若需使用真人作为主体参考,须经本人验证或取得授权,这一限制将影响部分商业素材生产与投放链路的使用方式。

字节跳动火山引擎初步确定于2026年2月14日发布豆包大模型一系列重要升级,涉及豆包大模型2.0、音视频创作模型Seedance 2.0、图像创作模型Seedream 5.0 Preview,预计基础模型能力和企业级Agent能力将有显著提升。